你可能一直在为一张“被切碎的GPU”付钱

听起来很合理,对吧?资源共享,提高利用率。

但问题是――用过的人都知道,这种“合理”,往往换来的,是另一种不合理。

为什么很多团队的GPU,越多越不好用

如果你做过设计、建模,或者跑过一些图形类应用,大概率有过这种体验:

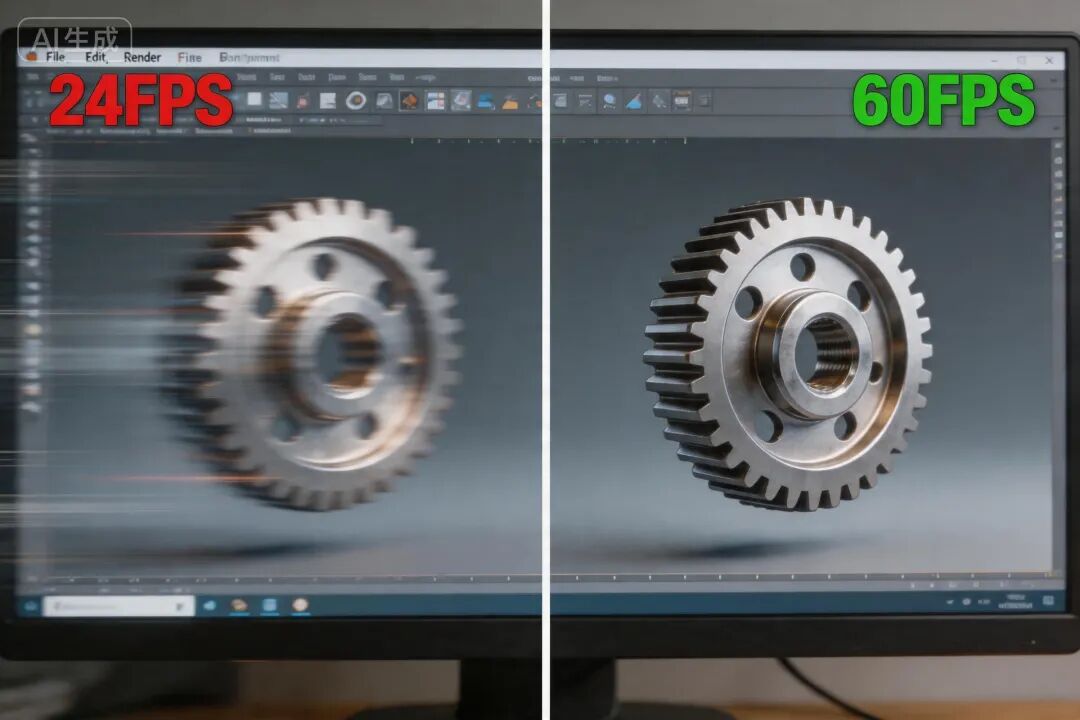

明明服务器配置不低,但操作就是不顺手。拖动卡顿,旋转掉帧,画面有时候甚至会糊。

你会以为是网络问题,或者电脑不行。但很多时候,真正的问题在于:你用的并不是一整张GPU。而是被“分配”到的一小块。

在传统虚拟化方案里,GPU通常会被切分:

每个人固定一部分显存每个人分到一部分算力

看起来很公平,但代价也很直接――没有人能真正用满性能。

就像一台高性能工作站,被拆成几台低配电脑分给大家用。谁都能用,但谁都用不爽。

有没有一种方式:不切GPU?

很多人默认这是“行业标准”,但其实这只是其中一种实现方式。问题在于,这种方式把一件事情做反了。

GPU本来就是一个高性能、按需使用的计算资源,但却被提前“切死”,再分配给用户。

那有没有一种更直接的方式?不切它。谁在用,谁拿性能;不用的时候,资源自动让出来。

听起来很简单,但这恰恰是过去很多方案没有做到的地方。

正睿的思路,其实只有一句话,我们做的事情,本质上很简单:

不拆GPU。

在正睿的高性能虚拟化图形桌面方案中:

每个用户在使用时,拿到的是完整GPU性能而显存和算力,是根据实际使用动态分配的

没有预先切分,也没有固定占用。

换句话说,GPU不是被“分给你一块”,而是“在你需要的时候,完整为你服务”。

这种变化,带来的不是参数提升,而是体验变化

很多人第一反应是:性能会不会更高?

但更直观的变化,其实是体验。

鼠标拖动是跟手的模型旋转是连贯的画面是清晰稳定的

用起来的感觉,更接近一台本地高性能工作站,而不是远程连接的一台“共享电脑”。

对于设计、建模、仿真这类高频交互场景,这种差异是很明显的。

不是跑分的差异,而是用起来顺不顺手的差异。

那为什么以前大家都在用“切卡”的方式?

一个很现实的原因,是技术路径和商业模式。

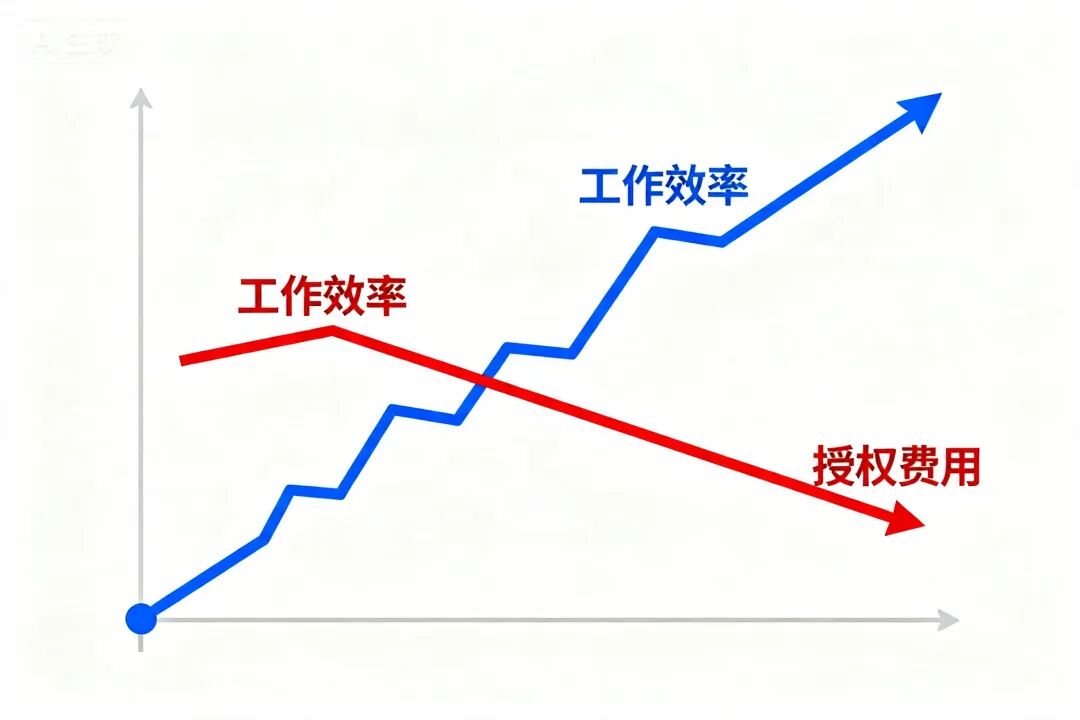

传统VGPU方案,本质上是:

把GPU切分再通过授权的方式使用

这意味着什么?

你不仅买了硬件,还要持续为“使用权”付费。

而且这种费用,是随着规模增长不断叠加的。

换一种方式,成本结构也变了

在正睿方案里,没有VGPU授权这一层。

设备和软件是整体交付的,不需要额外的订阅费用。

更重要的是,由于资源是动态分配的,同一张GPU可以被更高效地使用。

很多团队在实际使用中,会发现:

原本需要多张卡支撑的场景,现在可以用更少的资源完成。

这不仅是“少了一笔授权费”,而是整个投入方式都发生了变化。

灵活,不是说说而已

很多方案也会强调“灵活”,但实际用起来,很快就会遇到限制。

而这个方案的核心,其实就在“动态”两个字上。

不同用户的使用强度不同不同时间段的负载也不同

系统会根据实际情况去分配资源,而不是提前把资源锁死。

当然,这也意味着,对整体调度能力有一定要求。

但这本来就应该是系统去解决的问题,而不是让用户去为“资源被切碎”买单。

更适合哪些场景

如果你的团队涉及以下应用,这种方式会更容易体现价值:

设计类工作,比如CAD、三维建模高频交互的图形应用需要多人共享GPU资源的环境以及对画面质量和操作流畅度有要求的业务

这些场景有一个共同点:不是“能不能跑”,而是“用起来顺不顺”。

最后说一句实话

GPU被切开用,并不是错。它只是过去的一种选择。但现在,这已经不再是唯一的选择了。

当你开始关注体验、成本和资源利用方式的时候,会发现:

有些看起来“理所当然”的做法,其实是可以被替代的。

至少,在GPU这件事上,是这样。